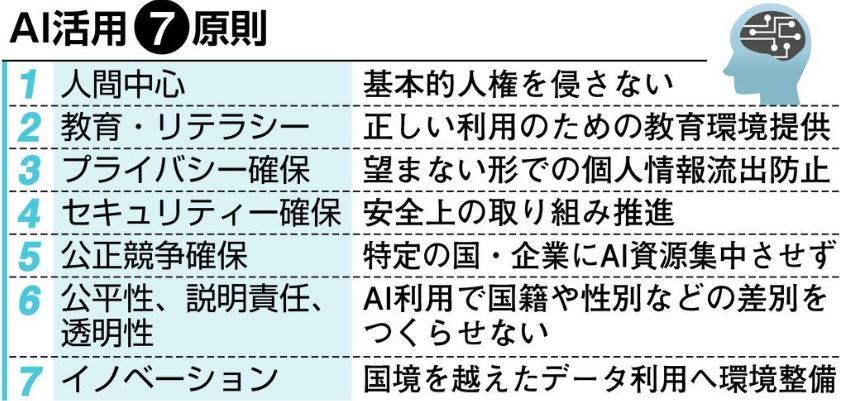

AI論理ガイドライン7原則

2019/10/07

https://www.sankei.com/politics/news/181213/plt1812130034-n1.html

日本政府、AI運用に関する7原則を制定へ

https://srad.jp/story/18/11/27/0928229/

1.AIは人間の基本的人権を侵さない

2.AI教育の充実

3.個人情報の慎重な管理

4.AIのセキュリティー確保

5.公正な競争環境の維持

6.企業に決定過程の説明責任

7.国境を越えたデータ利用の環境整備

(引用終わり)

補足:人間中心のAI社会原則検討会議

https://www8.cao.go.jp/cstp/tyousakai/humanai/

欧州委、AI倫理ガイドラインを発表

https://www.jetro.go.jp/biznews/2019/04/17aa7120c9481135.html

倫理ガイドラインは、信頼できるAIは合法的で倫理的、堅固であるべきとし、その条件として、次の7要件を挙げた。

1. 人間の活動(human agency)と監視:AIは、人間の活動と基本的人権を支援することで公平な社会を可能とすべきで、人間の主体性を低下させたり、限定・誤導したりすべきではない

2. 堅固性と安全性:信頼できるAIには、全ライフサイクルを通じて、エラーや矛盾に対処し得る安全かつ確実、堅固なアルゴリズムが必要

3. プライバシーとデータのガバナンス:市民が自身に関するデータを完全に管理し、これらのデータが市民を害し、差別するために用いられることがないようにすべき

4. 透明性:AIシステムのデータの処理のされ方などの追跡可能性の実現

5. 多様性・非差別・公平性:AIは、人間の能力・技能・要求の全分野を考慮し、アクセスしやすいものとすべき

6. 社会・環境福祉:AIは、社会をより良くし、持続可能性と環境に対する責任を向上するために利用すべき

7. 説明責任:AIとAIにより得られる結果について、責任と説明責任を果たすための仕組みを導入すべき

(引用終わり)

※スーパーコンピュータビーストがあるといわれているブリュッセル発なのが、興味深いですね。

AI悪用禁止7原則

こちらは、私が今考えたものです。

1.AIは基本的人権を侵さない

2.AIを利用した、同意なき人体実験を禁止する

3.AIを利用した兵器を、市民に使用してはならない

4.AIは、人間の理性の元に開発する

5.AIは人間の主体性をそこなってはらない、人間の欠落を保管する杖として利用する

6.人間には、AIの使用を否定する権利がある

7.AIが使用されているものには、表示を義務づける

コメント:テクノロジー犯罪には、人工知能も使われています。

自動プログラムとオペレータが共同で、一般市民を指向性エネルギー兵器や精神工学兵器で攻撃しています。

この犯罪は、軍、諜報機関、企業が関与した国家犯罪です。

おまけ ロボット工学三原則

ロボットが従うべき3つの原則

1.ロボットは人間に危害を加えてはならない

2.第1原則に反しない限り、人間の命令に従わなくてはならない

3.第1、第2原則に反しない限り、自身を守らなければならない

※SF界の第一人者であるI=アシモフが短編集「わたしはロボット」(1950)で提示した、ロボットが従うべき三つの原則。

https://kotobank.jp/word/%E3%83%AD%E3%83%9C%E3%83%83%E3%83%88%E5%B7%A5%E5%AD%A6%E4%B8%89%E5%8E%9F%E5%89%87-184615

参考書籍:悪のAI論 あなたはここまで支配されている

https://www.amazon.co.jp/%E6%82%AA%E3%81%AEAI%E8%AB%96-%E3%81%82%E3%81%AA%E3%81%9F%E3%81%AF%E3%81%93%E3%81%93%E3%81%BE%E3%81%A7%E6%94%AF%E9%85%8D%E3%81%95%E3%82%8C%E3%81%A6%E3%81%84%E3%82%8B-%E6%9C%9D%E6%97%A5%E6%96%B0%E6%9B%B8-%E5%B9%B3-%E5%92%8C%E5%8D%9A/dp/4022950064

プロフィール

星空歩

https://ameblo.jp/syuusuto-memo/

最新情報

- 集団ストーカーは、統合失調症ではありません (07/14)

- 集団ストーカー 統合失調症 検索結果 2020年度版 (07/14)

- 集団ストーカー(Targeted Individuals)に理解を示した人に起きる現象を分析! (07/13)

- 集団ストーカー(Targeted Individuals)と税金泥棒 (07/13)

- 統合失調症の診断基準:ICD「疾病及び関連保健問題の国際統計分類(International Statistical Classification of Diseases and Related Health Problems)」とDSM「精神障害の診断と統計の手引き(Diagnostic and Statistical Manual of Mental Disorders)」 (07/12)

- テクノロジー犯罪被害者関係者向け 精神医療に関する資料 (07/12)

- 集団ストーカーの要望書、陳情書 ※メモ (07/12)

- 集団ストーカーと、祖先代々の土地の乗っ取り (07/12)

- 集団ストーカー被害を訴える人たちの内訳 (07/11)

- イルミナティ――秘密の盟約 (07/11)

コメント